Wichtiges Update zum TFS HA-Version

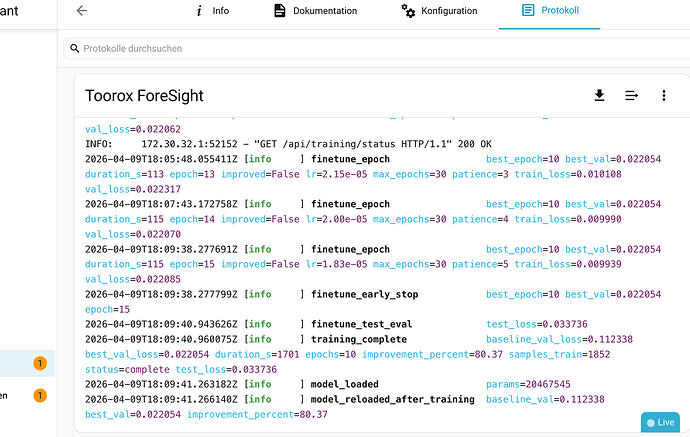

Das Preetraining ist erfolgreich durchgelaufen und das Modul wurde so eben zum erstem Mal in HA unter realen Bedingungen geladen und das Fine-Tuning mit den vorhandenen Daten aus SFML wurde automatisch gestartet und läuft wie geplant sehr resourchenschonend durch.

Hier ein paar Eckdaten zum Modell und der Effekt vom Fine-Tuning Script (sofern SAUBERE SFML Daten vorhanden sind)

Model:

Pre-Trained → Finde-Tunend

| Run | Baseline | Best | Improvement | Modell |

|---|---|---|---|---|

| g1 (broken train_zara) | 0.135 | 0.066 | −51% | from-scratch, nicht pretrained |

| g1 (korrekter _run_finetune) | 0.153 | 0.082 | −46% | echtes Transfer Learning |

| g4 (jetzt) | 0.112 | 0.022 | −80% | g4 Transfer Learning + group_mask |

−80% Verbesserung gegenüber der Pre-Training-Baseline! Das ist ein sehr großer Erfolg.

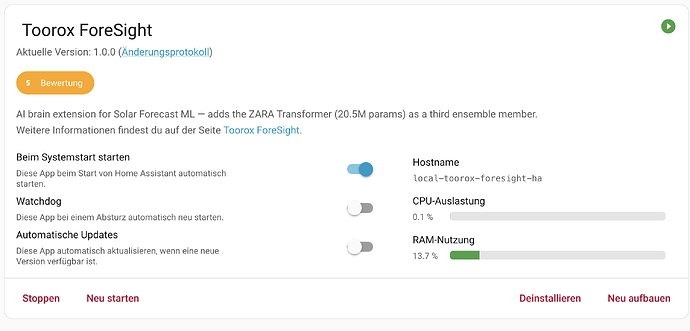

- Das Modell läuft unter HA

- Das Fine-Tuning / Anpassung mittels SFML DB auf die eigene Anlage erreicht noch mal eine ENORME Verbesserung um +80%

- Fine-Tuning " early Stopping" funktioinert (Modell erkennt wenn es nicht mehr besser wird)

- Die Überlegungen zur Resourchen Einsparung(en) um lauffähig unter HA zu sein greifen.

- Automatisches Erkennen von SFML und automatisches Einbinden der nötigen Sensoren - Check es muss NICHTS durch den Nutzer konfiguriert werden.

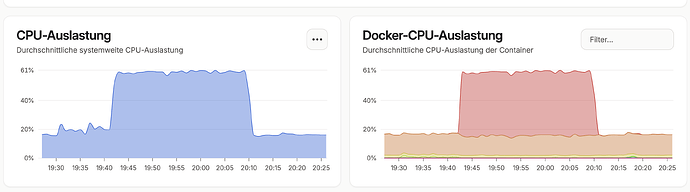

LAST auf dem HA Host während Fine-Tuning:

Lets get ready to rumble.. nun beginnt das echte Testen…

HA APP Protokoll:

HA IDLE und tatsächliche RAM-Nutzung auf dem HOST

Erster Forecat (heute) OHNE die Feinabstimmung sondern out of the box.. ERSTAUNLICH!!!

| g1 (03:09 Nacht) | g4 (20:18 Abend) | IST | |

|---|---|---|---|

| Total p50 | 15.94 kWh | 11.70 kWh | 11.02 kWh |

| Fehler | +4.92 (+44.6%) | +0.68 (+6.2%) | — |

| Per-group | keine | ✓ Gruppe 1 + 2 | — |

| Validation | 0.0 (broken) | 0.82 | — |

Versioinierung

G1 = Erste Version (BETA 1)

G2 = Broken (abgestürzt)

G3 = Broken (abgestürzt)

G4 = läuft! mit +6,2% aus dem Stand!

Es bleibt spannend.. morgen z.B. ist schweres Wetter (Wechslhaft mit Sonne und Regen)