Toorox ForeSight Home Assistant (TFS HA) ist fertig!

Wer den Thread zur Zukunft von SFML verfolgt hat, weiß, dass ich schon länger an einer sinnvollen KI-Erweiterung arbeite. Es wird zwei TFS Versionen geben, eine StandAlone und dieser hier TSF HA eine APP für Home Assistsnt.

Jetzt ist es soweit.

Was ist TFS HA?

TFS HA ist eine eigenständige Home Assistant App — kein HACS-Plugin, sondern ein vollwertiger Docker-Container, den Home Assistant lokal für euch baut.

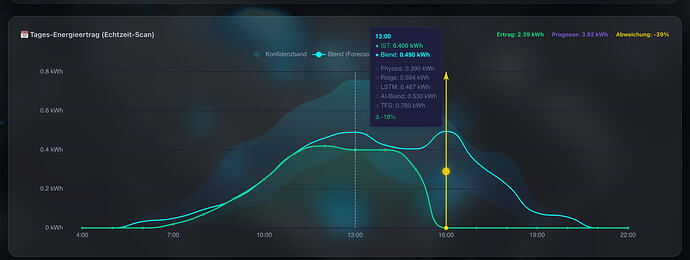

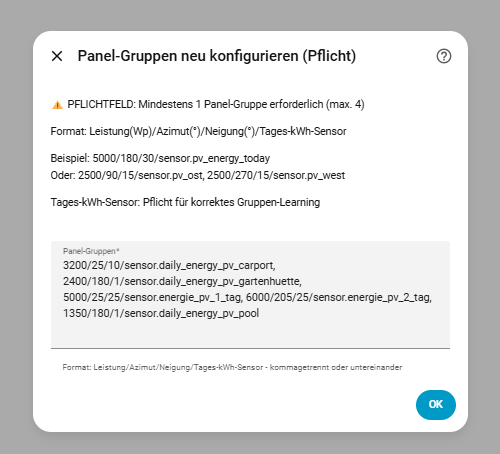

Im Container läuft der TFS G4v2 Transformer (8-Head, 20,5 Millionen Parameter), den ich auf einem großen, kuratierten Datensatz europäischer PV-Anlagen, Klimamodelle und Wetterdaten vortrainiert habe.

Kurz gesagt: TFS ist eine neuronale „Gehirnerweiterung“ für SFML. Es ersetzt den Hubble-Stack nicht, sondern wird bei schwierigen Wetterlagen (komplexe Bewölkung, Jahreszeitenwechsel, besondere atmosphärische Bedingungen) als dritte Expertenmeinung ins Ensemble gemischt.

So arbeitet TFS mit SFML zusammen

- SFML erstellt seine Prognose wie gewohnt (45 Min vor Sonnenaufgang, Mittags-Reforecast etc.)

- SFML fragt TFS nach dessen Einschätzung

- TFS liefert einen 72h-Forecast zurück

- SFML blendet den TFS-Wert gewichtet ins bestehende Ensemble ein

- Am Ende des Tages bewertet SFML die Qualität von TFS und passt die Gewichtung (pro Panelgruppe, pro Stunde, pro Wettersituation) automatisch an

Für euch ändert sich fast nichts:

TFS erzeugt keine eigenen Sensoren. Alles bleibt bei SFML. Ihr seht keine neuen Entities im Dashboard. TFS arbeitet komplett im Hintergrund.

Was TFS nicht ist

- Kein Ersatz für SFML (TFS benötigt SFML und liest automatisch eure komplette Konfiguration aus der SFML-Datenbank)

- Keine zusätzlichen Entities oder Dashboards

- Keine Cloud, keine Telemetrie, kein LLM-Ingest — alles 100 % lokal

- Wichtig: Die Roh-Prognosen von TFS sind nicht für direkte Automationen gedacht

Hardware-Anforderungen (bitte ernst nehmen)

Nicht empfohlen (wird frustrierend):

- HA Green / Yellow

- Raspberry Pi 4 oder älter

- SD-Karten-Installationen

- Intel-CPUs vor Skylake (2015/2016)

- Weniger als 6 GB RAM

Empfohlen:

- Moderner x86_64-Prozessor (Intel 6. Gen+ oder Ryzen)

- 6–8 GB RAM (mehr ist besser)

- SSD oder NVMe

- Home Assistant 2026.3.0 oder neuer + SFML ≥ 20.0.0

Erstes Finetuning-Dauer (einmalig):

| Hardware | Dauer |

|---|---|

| i7 12. Gen / Ryzen 5 5600+ | 10–15 Min |

| i5 10./11. Gen | 20–30 Min |

| Älterer x86_64 (2016–2018) | 30–45 Min |

| Raspberry Pi 5 (8 GB) | 40–60 Min |

Wichtig: Während des ersten Trainings das Add-on nicht stoppen!

Installation (sehr einfach)

Voraussetzung: SFML 20.0.0+ und STATS 16.0.0+

-

Im HA-UI → Einstellungen → Add-ons → Add-on Store

-

Oben rechts auf die drei Punkte → Repositories

-

Diese URL hinzufügen:

https://github.com/Zara-Toorox/TFS-HA-SFML-Transformer-AI -

„Toorox ForeSight“ erscheint → Installieren → Starten

Danach passiert alles automatisch. Keine weitere Konfiguration nötig.

Automatisches Lernen im Betrieb

- Alle 6 Stunden: Drift-Detection

- Täglich 02:00 Uhr: Inkrementelles Finetuning (ca. 5–10 Min)

- Quartalsweise: Re-Kalibrierung

- Bei starkem Drift: Automatisches Notfall-Training

Nach einer frischen SFML-Installation wartet TFS erst 10 Tage, bis genug Daten vorhanden sind.

Technik – Warum TFS etwas ganz Besonderes ist (für die Nerds  )

)

TFS HA (Codename ZARA) ist kein „irgendwas mit KI“ – es ist ein reiner, von Grund auf für Solarprognosen entwickelter Transformer. Kein LSTM, kein Ridge-Regression, kein klassisches ML-Modell und erst recht kein abgeleitetes Chat-LLM.

Die Architektur orientiert sich bewusst an den neuesten Entwicklungen moderner Large Language Models (Llama, Qwen etc.), wurde aber ausschließlich für die hochkomplexe Aufgabe der PV-Energieprognose optimiert. Hier die Highlights, die TFS so einzigartig machen:

-

Encoder–Decoder-Struktur

Der Encoder analysiert stündlich den kompletten Wetter- und Produktionsverlauf der letzten Stunden (inkl. aller Sensoren und Panelgruppen). Der Decoder erzeugt daraus einen präzisen 72-Stunden-Forecast. Das ermöglicht echtes „Kontext-Verständnis“ über lange Zeiträume – etwas, das klassische Modelle nicht können. -

Multi-Head Attention

Das Modell kann gleichzeitig auf mehrere zeitliche und saisonale Muster achten: Tagesgang, Wochenrhythmus, Wetterwechsel, Jahreszeiten etc. Es erkennt Zusammenhänge, die ein Mensch nur schwer formulieren könnte. -

Rotary Position Embeddings (RoPE)

Im Gegensatz zu einfachen Positions-Encodings versteht das Modell nicht nur die Reihenfolge der Daten, sondern wann genau etwas passiert. Das ist entscheidend für saisonale und tageszeitliche Effekte. -

RMSNorm + SwiGLU

Moderne Normalisierungs- und Aktivierungsfunktionen (wie sie in den aktuellsten LLM-Architekturen verwendet werden). Deutlich stabiler und effizienter als die alten LayerNorm + ReLU-Kombinationen – führt zu schnellerem Training und robusteren Vorhersagen. -

Mixture-of-Experts (MoE)

Statt einem starren neuronalen Netz arbeiten mehrere spezialisierte „Experten-Sub-Netze“ zusammen. Je nach Wetterlage (z. B. Hochnebel, Cirrus-Bewölkung, Föhnlage) wird automatisch das passende Sub-Netz aktiviert. Das macht das Modell extrem anpassungsfähig an unterschiedliche europäische Klimazonen. -

Quantile-Ausgabe (P10 / P50 / P90)

TFS liefert nicht nur einen einzigen Punktwert, sondern komplette Konfidenzintervalle. SFML kann dadurch zwischen „sehr sicherer Prognose“ und „unsicherer Situation“ unterscheiden und die Gewichtung noch intelligenter anpassen.

Pretraining & Finetuning

Das Modell wurde zuerst auf einer riesigen, europaweiten Datenbasis (viele PV-Anlagen + mehrjährige hochaufgelöste Klimadaten) vortrainiert. Es bringt daher schon ein physikalisch fundiertes Vorwissen über Solar-Muster mit – bevor es eure Anlage überhaupt gesehen hat. Das anschließende Finetuning auf euren lokalen Daten (Dachgeometrie, Mikroklima, Verschattung, Inverter-Verhalten) verschiebt dann nur noch fein die Gewichte.

Warum ein Transformer und kein einfacheres Modell?

Ein klassisches Regressions- oder LSTM-Modell sieht nur „jetzt bewölkt → weniger Strom“. Ein Transformer erkennt dagegen komplexe kausale Ketten wie:

„Gestern Nachmittag dünne Cirrus + heute Nacht Winddrehung + aktuelle Luftfeuchte → morgen Vormittag deutlich klarer als jede Wetter-API vorhersagt.“

Genau dieses tiefe Kontext-Reasoning über lange Zeithorizonte war bei bisherigen Solarprognose-Modellen das große Manko.

Was das Modell bewusst NICHT ist:

- Kein Chat-Modell oder GPT-Derivat

- Kein Transfer-Learning aus fremden Text-Modellen

- Kein „PyTorch-Geraffel“ mit Halluzinations-Risiko

Es ist eine saubere, hoch-spezialisierte, aufgabenspezifische Architektur, die nichts anderes kann – und genau deshalb in ihrem Bereich herausragend gut ist.

Status & Tester gesucht

Das Add-on läuft bei mir seit mehreren Tagen stabil im Dauerbetrieb.

Ich suche jetzt erste Tester. Besonders interessiert bin ich an eurem Feedback zu:

- Installationserfahrung & Build-Zeit

- Dauer des ersten Finetunings auf eurer Hardware

- Stabilität und Qualität der kombinierten SFML+TFS-Prognosen

Fragen, Feedback, Bugs oder Erfahrungsberichte gerne hier im Thread!

Und wer mich mit einem Kaffee bei den nächtlichen Coding-Sessions unterstützen möchte:

Aktuelle Version:

BETA

Release:

15.04.2026 (nach Update von SFML und STATS)